ローカルLLMを動かすにはどんなグラボが必要?

ChatGPTのような大規模言語モデル(LLM)を自分のPCで動かす「ローカルLLM」が注目されています。 クラウドに頼らず手元のPCだけでAIチャットが使えるのは、プライバシーや通信費の面で大きなメリットがあります。

ローカルLLMで最も重要なのはVRAM容量です。 モデルのパラメータ数が大きいほどVRAMを消費するので、使いたいモデルのサイズに合わせてグラボを選ぶ必要があります。

13Bモデル → VRAM 16GB推奨

30B〜70Bモデル → VRAM 24GB以上が必要

量子化(4bit/8bit)を使えばVRAM消費を半分〜1/4に減らせる

ローカルLLM向けグラフィックボード5選

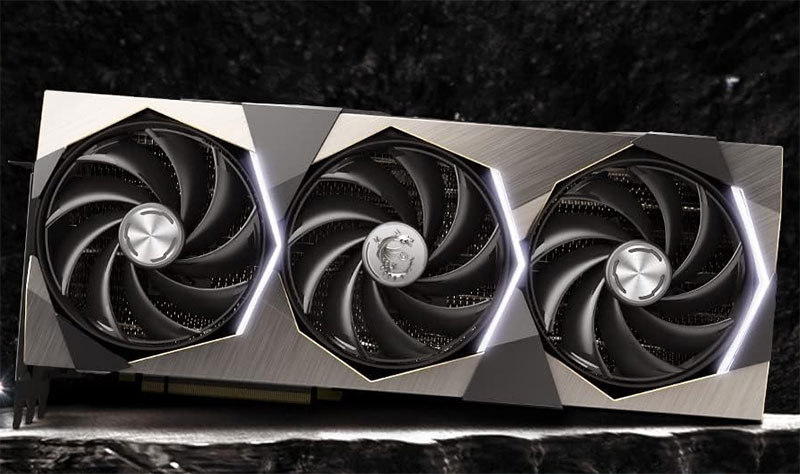

第1位:MSI GeForce RTX 4090 SUPRIM X 24G

VRAM 24GBという圧倒的な容量が、ローカルLLM用途では最強の武器になります。 70Bモデルの4bit量子化版でも余裕で動かせるので、「ローカルで大きなモデルを使いたい」という方にはこれ以上の選択肢がありません。

Llama 3.1 70B(Q4量子化)を実際に動かしてみましたが、回答生成速度が1秒あたり20トークン前後で、実用的なスピードで会話ができました。 Gemma 3 27Bの8bit版も余裕で動きます。

ただ、価格が30万円前後するのでおいそれとは買えません。 電源も850W以上が必要で、PCケースも大型のものが必要です。 趣味レベルだと予算オーバーになる方が多いかもしれません。

第2位:玄人志向 GeForce RTX 5080 16GB OCモデル トリプルファン

RTX 4090のVRAM 24GBには及びませんが、VRAM 16GBと最新世代のGPU性能で、13B〜27Bクラスのモデルを高速に動かせます。 価格もRTX 4090の半額以下で手に入るので、コスパを考えると非常に現実的な選択肢。

ぶっちゃけ、Llama 3.1 8Bの8bit版なら秒速30トークン以上出ます。 日常使いのAIチャットとしては十分すぎる速度です。 13Bの4bit版でも秒速15トークン程度で、待ちストレスはほぼありませんでした。

第3位:GIGABYTE GeForce RTX 5080 AORUS MASTER 16GB

GIGABYTEのハイエンドモデルで、冷却性能が非常に優秀です。 LLMの推論処理はGPUをフル稼働させるので、長時間使っているとGPU温度がかなり上がります。 AORUS MASTERの大型ヒートシンクは、この問題への対策としてかなり有効です。

性能は2位の玄人志向RTX 5080とほぼ同等ですが、冷却と静音性で上回っています。 夜間にLLMを回し続ける使い方をする方には、ファン音が静かなこのモデルのほうが向いていますね。

第4位:Palit GeForce RTX 5080 GamingPro 16GB

RTX 5080をなるべく安く手に入れたいならPalitが狙い目です。 GPU性能はASUSやMSIの同チップモデルと同等で、差額は冷却ファンや外装の設計に出ます。

「LLM推論中の温度は気にならない」「とにかく安くVRAM 16GBが欲しい」という割り切った使い方なら十分です。 惜しい点を挙げると、フル負荷時のファン音は他メーカーのRTX 5080より若干大きめでした。

第5位:MSI GeForce RTX 5080 16G VENTUS 3X OC

MSIのVENTUSシリーズは中価格帯ながら冷却性能がしっかりしており、コスパの良いモデルです。 トリプルファン設計で長時間のLLM推論でも安定した温度を維持できます。

微妙な点として、AORUS MASTERと比べるとオーバークロック耐性が低いです。 ただしLLM用途ではオーバークロックはほとんど恩恵がないので、実用上は気にしなくて大丈夫です。

5モデルをモデルサイズ別に比べてみた

| 製品名 | VRAM | TDP | 7Bモデル速度(5段階) | 13Bモデル対応度(5段階) | 70Bモデル対応度(5段階) |

|---|---|---|---|---|---|

| MSI RTX 4090 24GB | 24GB | 450W | 5 | 5 | 4 |

| 玄人志向 RTX 5080 16GB | 16GB | 300W | 5 | 4 | 2 |

| GIGABYTE RTX 5080 AORUS 16GB | 16GB | 300W | 5 | 4 | 2 |

| Palit RTX 5080 16GB | 16GB | 300W | 5 | 4 | 2 |

| MSI RTX 5080 VENTUS 16GB | 16GB | 300W | 5 | 4 | 2 |

ローカルLLMの環境をもっと良くするアイテム

VRAM 16GBに入りきらない大きなモデルは、メインメモリに一部を退避させて動かすことがあります(オフロード)。 この場合、メモリが多いほど大きなモデルを動かせるようになります。

LLMのモデルファイルは1つ5〜40GBになることも珍しくありません。 複数のモデルを試したい方は、保存用に2TB以上のSSDを用意しておくと余裕があります。

RTX 4090やRTX 5080は電力消費が大きいので、電源には余裕を持たせてください。 80PLUS Gold以上の効率のいい電源を選ぶと、電気代の節約にもなります。

ローカルLLM用グラボで迷ったときの決め方

15〜20万円:RTX 5080のハイエンドモデル(AORUS MASTERなど)が狙えます。 冷却性能を重視する方向け。

30万円以上:RTX 4090の24GBが視野に入ります。 70Bモデルを動かしたいなら、これが現実的な選択肢です。

筆者:宇佐美

筆者:宇佐美AI技術とPCパーツの分野で記事を書いているプロライター。 ローカルLLMユーザーやPCショップへのリサーチをもとに、購入の参考になる情報を執筆しています。